AI声音滥用不时发生

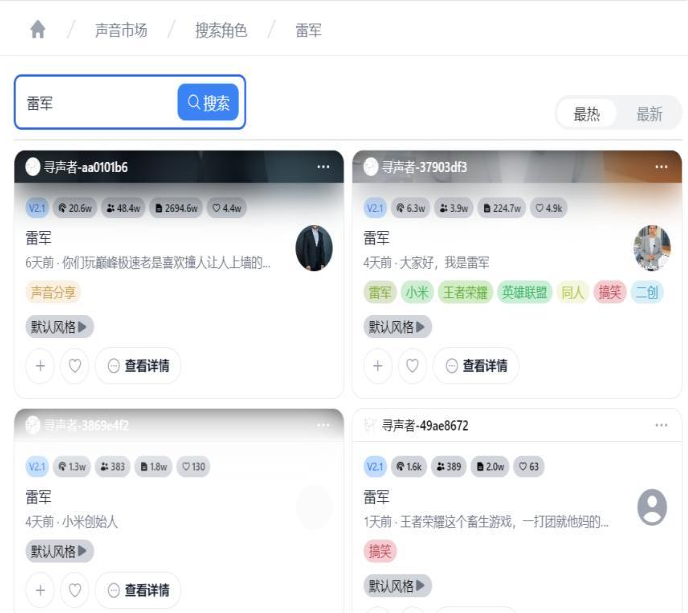

在应用商店搜索发现,大量软件具备相关功能,一些APP的下载量超千万次。选择一款APP进行模拟,只需简单念出一段文字或输入音频片段,这些APP十几秒即可完成声音的合成。

在社交平台上,通过AI模仿恶搞各领域名人的音视频不在少数。此前,短视频平台涌现了大量AI模仿某知名企业家声音吐槽堵车、调休、游戏等热门话题的视频,个别视频甚至还有脏话出现,一度登上热搜。该企业家随后发视频回应称:“相关事件的确让自己挺困扰,也挺不舒服,希望大家都不要‘玩’了。”

一些商家在短视频平台带货时,通过AI模仿声音技术将主播“变”为知名女明星、知名医生,销售服装、保健品等相关产品,对消费者造成了严重误导。国家传染病医学中心主任、复旦大学附属华山医院感染科主任张文宏接受媒体采访时表示,通过语音合成来模仿他的声音进行直播带货,这样的账号“不止一个,且一直在变”,他多次向平台投诉但屡禁不绝。

胖东来创始人于东来的声音也曾频遭AI模仿,相关平台出现了大量与事实不符的合成视频。胖东来商贸集团为此发布声明称,多个账号未经授权擅自利用AI技术手段生成于东来的声音,加入误导性文案,对公众造成误导和混淆。

声音是如何被“偷”走的?

个人的声纹信息,作为一种生物识别特征,具有高度的可识别性,能够被电子手段精确记录。其独特性、唯一性及稳定性,使其成为将信息与特定自然人相关联的关键要素。根据《个人信息保护法》的规定,声纹信息被归类为敏感个人信息,受到严格保护。

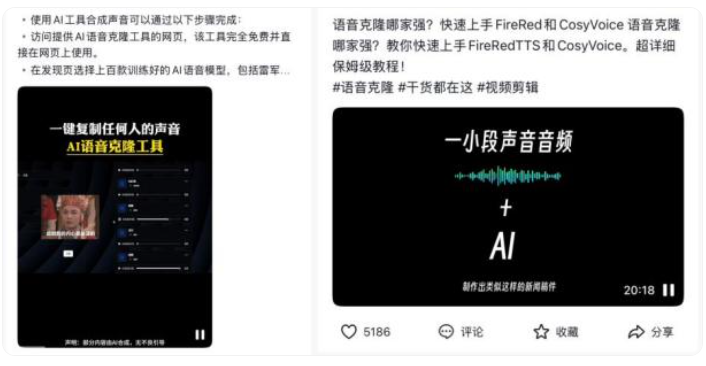

AI技术如何生成“以假乱真”的声音?AI能够“克隆”声音,主要是依靠深度学习算法,即短时间内从采集的声音样本中提取关键特征,包括频率、音色、声调、语速、情感等,将这些特征记录为数学模型,再通过算法合成。

中国科学院自动化研究所模式识别实验室工程师牛少东说,随着算法越来越先进,在高性能设备和高精度模型的加持下,AI生成的语音内容从两年前的“一眼假”升级到如今的“真假难辨”。

大四学生耿孝存最近经常在网络音乐播放器中收听几首翻唱歌曲,他一直以为这些歌曲由某知名女歌手翻唱,后来才得知其实全部是AI合成的。“声音逼真到我从来没怀疑过。”耿孝存说。

AI声音在最近一两年时间内变得格外“流行”。清华大学新闻与传播学院教授沈阳说,人工智能技术的普及,让AI模拟声音的门槛大幅降低。通过一些开源软件和平台,没有专业知识的普通用户也能操作。

“只需拥有少量的声音素材,即可迅速实现声音的‘AI 克隆’。”一位不愿透露姓名的技术人员说。

大量App能够进行AI合成声音,最快只需十几秒。记者在应用商店搜索发现,相关App有数十款,下载量最高超千万次。

记者联系了一款App的客服人员,对方表示,花198元就能解锁付费会员,对着镜头说几遍“12345”,AI就会根据声音生成各类内容的出镜口播视频。记者操作后发现,通过这款软件生成的名人声音,基本可以以假乱真,且录入名人声音不需要提供任何授权证明。

业内人士告诉记者,AI模拟人声在互联网“流行”,有追逐流量和变现的目的。通过“克隆”名人声音制作的恶搞、猎奇类视频,在相关平台播放和点赞量均不低,有的甚至还被推上热搜。发布者也相应获得流量曝光、粉丝增长、广告收入等播放收益。

擅自将他人声音AI化不合法

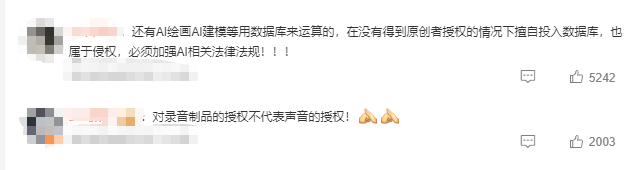

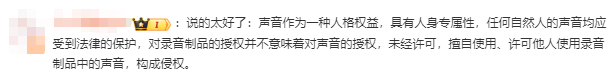

用AI生成他人声音,是否违法违规?多位受访专家表示,个人声音中包含的声纹信息具备可识别性,能以电子方式记录,能关联到唯一自然人,是生物识别信息,属于个人信息保护法规定的敏感个人信息之一。

2024年4月,北京互联网法院宣判全国首例“AI声音侵权案”,明确认定在具备可识别性的前提下,自然人声音权益的保护范围可及于AI生成声音。该法院法官认为,未经权利人许可,擅自使用或许可他人使用录音制品中的声音构成侵权。

在法律层面,民法典第一千零二十三条规定,对自然人声音的保护,参照适用肖像权保护的有关规定。而在AI生成声音的过程中,涉及声音样本的采集、使用、算法的研发和应用等多个环节,每个环节都可能涉及不同主体的权益。因而,有关部门要与时俱进完善声音权益保护的法律体系,细化AI克隆技术的法律条款,并明确侵权行为的定义和责任。

在治理层面,应多措并举。其一,平台要切实履行好监管责任,建立健全对AI声音的审核和侵权举报机制,及时发现和拦截侵权、虚假、违法等不良内容;其二,相关部门要加大对利用AI技术进行诈骗等违法犯罪行为的打击力度,并形成更加完善的常态化治理机制;其三,个人也必须加强对个人生物特征信息的保护意识。

说到底,人工智能带来的改变,应当是公共服务质量的优化,是公众获得感的提升。

本文综合自千龙网、上观新闻、华声在线、网友评论